密歇根大学研究者借助生物力学约束,让无人驾驶汽车理解行人的预行为

在自动驾驶应用中,理解、推断和预测行人的意图和未来行为非常重要。这种能力使车辆避免碰撞,提高行驶安全和质量。预行为理解即对对方可能产生的行为进行准确的预估和判断,随着深度学习网络、长短期记忆、选择性注意机制以及提取知觉物体等技术的发展,人体姿态估计得到了广泛的研究。

姿态估计的目标是在RGB图像或视频中描绘出人体的形状,这是一种多方面任务,其中包含了目标检测、姿态估计、分割等等。有些需要在非水平表面进行定位的应用可能也会用到姿态估计,例如图形、增强现实或者人机交互。姿态估计同样包含许多基于3D物体的辨认。

目前比较流行的工作主要集中在,从当前帧中的单个静态RGB图像估计人体骨骼模型的关节位置,而没有解决未来帧的位置预测问题。当然也有研究人员开始研究给定视频序列的人体姿势预测(预测和预测),不过大部分工作都集中在基于骨架的关节位置表示上。

比如:Google的人体姿态估计,论文采用top-down的结构,分为两个阶段: 第一阶段使用faster rcnn做detection,检测出图片中的多个人,并对bounding box进行image crop; 第二阶段采用fully convolutional resnet对每一个bonding box中的人物预测dense heatmap和offset; 最后通过heatmap和offset的融合得到关键点的精确定位。

而密歇根大学的研究者提出了一种基于生物力学的循环神经网络(biolstm),该网络可以在全局坐标系下,预测行人的位置和三维关节体位姿,但在已有坐标系下估计的三维位姿和位姿是不准确的。该网络能够同时预测多个行人的姿态和位置,距离摄像机45米以内的行人都可以预测到。据了解,该方法是基于一种新的目标函数,该目标函数包含了人体步行周期(步态)、人体镜像对称性和人体步态周期中地面反作用力的变化。

“这方面的先前工作通常只看静止图像,并没有真正关注人们如何在三个方向上移动,“密歇根大学机械工程助理教授 Ram Vasudevan说,“但如果这些车辆要在现实世界中运行和互动,我们需要确保对行人所在位置的预测与车辆下一步的位置是否有存在冲突。”

过去一台计算机显示了数百万张停车标志的照片,通过机器学习的方法,最终会在现实世界中实时识别停车标志。但是通过利用运行几秒钟的视频片段,系统可以利用研究片段的前半部分进行预测,然后通过后半部分验证准确性。

为了解释神经网络做出的推断,Vasudevan 描述了一个常见的景象。“如果一个行人正在玩手机,你知道他们会分心,”Vasudevan 说。“他们的姿势和他们正在寻找的地方会告诉你他们的注意力分布,也会告诉了你很多关于他们下一步能做什么的事情。“

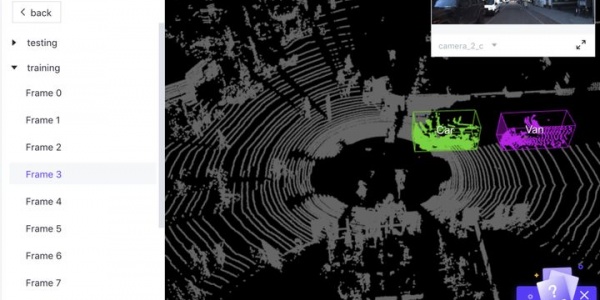

该模型在PedX 数据集进行了测试,PedX数据集是在真实的城市人行横道交叉口采集的大规模野外数据集,于2017年在美国密歇根州安娜堡市中心的真实城市交叉口收集。该数据集包含三个四路交叉口的行人流量大的集合,包含10000多个行人姿势和1800多个不同长度的连续序列(平均序列长度为6帧)。

PedX数据集由两个立体声RGB相机对和四个Velodyne激光雷达传感器的数据组成。摄像机视频以大约每秒6帧的速度采集。通过优化人工标注的二维行人姿态和三维激光雷达点云,最终得到每帧的三维行人姿态。结果表明,该网络能够成功地学习行人步态特征,并能产生准确一致的三维姿态预测。

目前,该工作主要针对城市交叉口的行人姿态预测,仅仅分析了行人的行走和站立活动,但有可能通过这项工作来预测其他活动,比如跑步。新的目标函数在对行人步态预测方面,向生物力学约束迈出了第一步。然而,对于人类许多方面的步态特征仍需进一步研究。

未来,或许这种结合了姿态估计和端到端姿态预测分析系统可以整合到无人驾驶计算平台上,用于无人车更准确的理解行人预行为。

广告

广告 最新资讯

-

国内首个“路空一体”国家级测试基地!南方

2026-03-23 17:23

-

1.5亿欧元项目投产,被动安全测试实验室同

2026-03-23 14:40

-

汽车测试方式大变局:工程师开始“远程做实

2026-03-23 14:38

-

国内首个螺栓式换电系统互换标准在厦门发布

2026-03-23 13:36

-

聚焦GB 45672-2025落地实施 | 中国汽研信息

2026-03-23 13:35

广告

广告